A medida que los negocios y la audiencia se vuelven cada vez más digitales, los sitios web y las aplicaciones web se convierten en herramientas críticas para el crecimiento del producto. Pero cuando el tráfico aumenta, es fundamental que la infraestructura del servidor pueda soportar esa carga. Nginx y Apache son dos de los servidores web más conocidos, y entender sus fortalezas ayuda a tomar decisiones técnicas más sólidas.

Nginx o Apache: ¿cuál elegir?

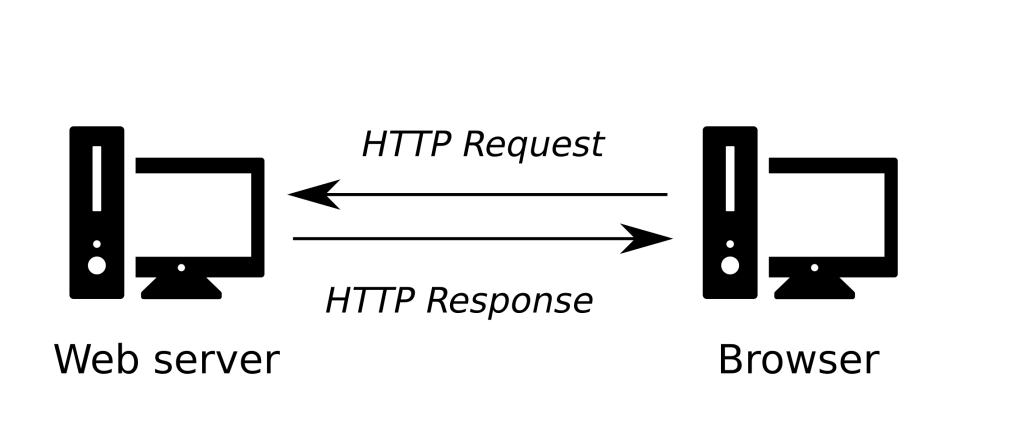

Tanto Nginx como Apache son servidores web open source que actúan como puente entre backend y frontend. Apache lleva muchos años siendo una opción muy popular, mientras que Nginx destaca especialmente por su velocidad y escalabilidad.

Nginx utiliza una arquitectura asíncrona orientada a eventos, lo que le permite manejar un gran número de conexiones concurrentes con un consumo de recursos relativamente bajo. Por eso suele ser una muy buena elección para sistemas de alto tráfico. Apache, por otro lado, usa una arquitectura basada en procesos, que puede resultar más cómoda para proyectos más tradicionales o menos exigentes.

Al mismo tiempo, Apache cuenta con un ecosistema muy amplio de módulos y plugins, lo que lo hace más flexible para necesidades específicas. Nginx, en cambio, es especialmente fuerte en load balancing y suele utilizarse mucho en sistemas distribuidos.

La elección final entre Nginx y Apache depende de las necesidades concretas del proyecto. Si la prioridad es velocidad, eficiencia y escalabilidad bajo mucha carga, Nginx suele ser la mejor opción. Si importa más la flexibilidad y la variedad de integraciones, Apache puede resultar más adecuado.

Escalabilidad y rendimiento

Pero elegir el servidor correcto es solo una parte del problema. Para que un sitio o una aplicación web funcionen bien, también conviene tener en cuenta otros factores:

- Hardware del servidor: CPU, RAM y almacenamiento deben ajustarse al tráfico y al volumen de datos.

- Caché: Redis, Varnish y otros mecanismos de caché pueden mejorar mucho los tiempos de respuesta.

- Balanceo de carga: distribuir el tráfico entre varios servidores evita la sobrecarga de un único nodo.

- CDN: una red de distribución de contenido reduce la latencia y mejora la entrega de recursos estáticos.

Cuando se combina la tecnología de servidor adecuada con una configuración correcta de infraestructura, es posible obtener un sistema mucho más rápido, estable y preparado para escalar.